Les caméras « augmentées » ou algorithmiques dans l’espace public

18 novembre 2024

De plus en plus d’acteurs interrogent la CNIL sur la possibilité de recourir aux caméras « augmentées », notamment dans le contexte de l’expérimentation prévue par la loi JOP 2024. Quel est le cadre juridique applicable ? Quels sont les cas d’usage autorisés ? La CNIL dresse un état des lieux.

Les caméras dites « augmentées » sont des dispositifs vidéo auxquels sont ajoutés des traitements algorithmiques d’analyse automatisée d’images.

Compte tenu des enjeux pour les droits et libertés des personnes, la CNIL a publié, en 2022, sa position sur l’usage de ces dispositifs dans les lieux ouverts au public, dans laquelle elle expose ses réflexions et ses analyses sur le sujet d’un point de vue éthique, technique et juridique.

Depuis, la CNIL a reçu de nombreuses questions sur la légalité de ces dispositifs, notamment au regard de la loi sur les Jeux olympiques et paralympiques du 19 mai 2023 et de la diversification croissante des cas d’usage.

La CNIL rappelle le cadre applicable à ces dispositifs fonctionnant en temps réel dans les espaces ouverts au public.

Cette fiche n’aborde pas les dispositifs mis en œuvre dans les espaces privés.

De quoi parle-t-on ?

Les caméras « augmentées » intègrent des technologies de « vision par ordinateur », qui ajoutent une surcouche logicielle au système de caméra, ce qui permet l’analyse automatisée des images en reconnaissant des objets, des formes, des silhouettes, des mouvements ou encore des évènements. Ces traitements algorithmiques peuvent être soit couplés à des caméras de vidéoprotection déjà existantes, soit spécifiquement déployés avec des dispositifs dédiés.

Les cas d’usages de ces dispositifs peuvent être multiples, tant par les finalités (ou objectifs) poursuivies, la nature des acteurs responsables (publics ou privés), ainsi que les lieux et infrastructures concernés.

Exemples :

- la détection automatisée d’infractions présumées (stationnement interdit, circulation à contre-sens, dépôt sauvage d’ordures, usage d’un moyen de déplacement interdit dans le lieu concerné etc.) ou d’événements « suspects » ou potentiellement dangereux (attroupements d’individus, port d’armes, etc.) ;

- la détection de bagages abandonnés ;

- la mesure d’affluence et de la fréquentation sur les quais du métro ou d’une gare afin de diffuser des messages informatifs à l’intention des usagers (zones à éviter, espaces ou itinéraires à privilégier, etc.) ou d’améliorer la gestion du réseau.

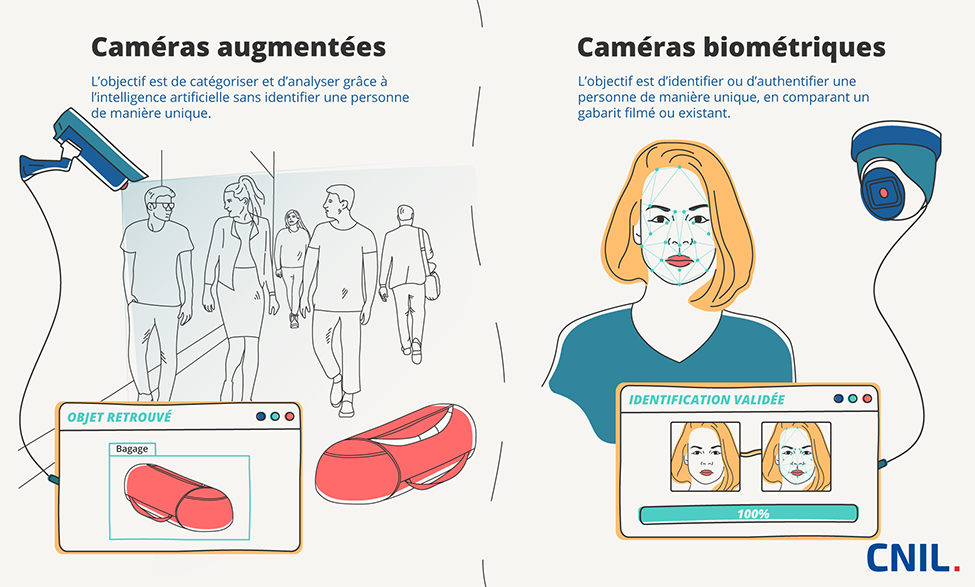

Caméras biométriques et caméras « augmentées » : quelles sont les différences ?

Deux critères permettent de distinguer les dispositifs de vidéo « augmentée » des dispositifs de reconnaissance biométrique (par exemple de reconnaissance faciale) :

- la nature des données traitées : caractéristique physique, physiologique ou comportementale ;

- l’objectif du dispositif : identifier ou authentifier de manière unique une personne.

Un dispositif de reconnaissance biométrique cumulera toujours ces deux critères, tandis qu’une caméra « augmentée » n’en remplira aucun (par exemple une caméra « augmentée » qui filme la rue pour classer les différents usages : voitures, vélos, etc.) ou seulement un des deux (par exemple une caméra « augmentée » qui détecte les bagarres dans une foule).

Cette distinction a des conséquences juridiques : les dispositifs de reconnaissance biométrique impliquent des traitements de données dites « sensibles » qui sont, par principe, interdits par le RGPD et la loi Informatique et Libertés, sauf exceptions.

Les risques pour les droits et libertés individuels

Une technologie d’analyse automatisée d’images par nature intrusive

Les caméras « augmentées » sont, par nature, très différentes de celles traditionnellement déployées : les personnes ne sont plus seulement filmées, mais analysées de manière automatisée, en temps réel, afin de collecter certaines informations les concernant.

Ces nouveaux outils vidéo peuvent conduire à un traitement massif de données personnelles, potentiellement à l’insu des personnes du fait du caractère « invisible » des logiciels d’analyse d’images intégrés aux caméras.

Un risque accentué de surveillance généralisée

Le risque d’une surveillance généralisée induit par la multiplication des dispositifs vidéo, pointé depuis longtemps par la CNIL, prend une nouvelle dimension avec l’essor des dispositifs de vidéo « augmentée » : cette surveillance se double d’une analyse des personnes.

Le déploiement de ces dispositifs dans les espaces publics, où s’exercent de nombreuses libertés individuelles (liberté d’aller et venir, d’expression, de réunion, droit de manifester, liberté de culte, etc.), présente des risques pour les droits et libertés fondamentaux des personnes et la préservation de leur anonymat dans l’espace public.

Ces dispositifs posent également de nouveaux enjeux pour les personnes lorsqu’ils ont vocation à automatiser entièrement certaines activités de la vie courante, renforçant le sentiment de surveillance des personnes.

Dans quels cas ces dispositifs sont-ils légaux ?

À l’exception du cadre expérimental prévu par la loi sur les Jeux olympiques et paralympiques du 19 mai 2023 (voir plus bas), il n’existe pas actuellement de texte spécifique encadrant l’usage des dispositifs de vidéo « augmentée ».

La légalité du déploiement de ces caméras « augmentées » doit être appréciée en fonction des cas d’usage et des finalités poursuivies au regard de la réglementation en vigueur (pour plus d’informations, voir le tableau récapitulatif des règles à respecter pour déployer certains dispositifs de caméras « augmentées » dans les lieux ouverts au public).

Les dispositifs les plus intrusifs sont interdits en l’absence de loi

Les dispositifs susceptibles d’affecter les garanties fondamentales apportées aux citoyens pour l’exercice des libertés publiques ne pourront être déployés que si une loi les autorise et les encadre spécifiquement.

Ainsi, en principe, les dispositifs de caméras augmentées qui poursuivent notamment une finalité dite « police-justice » sont interdits en l’absence de cadre légal spécifique, ce qui recouvre notamment les analyses réalisées en temps réel en vue d’une intervention immédiate ou de l’enclenchement de procédures administratives ou judiciaires par les services de police.

Les services de police de l’État ou les collectivités territoriales ne sont pas autorisés à ce jour par la loi à mettre en place des dispositifs d’analyse automatique des images permettant de repérer des comportements contraires à l’ordre public ou des infractions.

Le cadre expérimental prévu par la loi JOP2024

La loi n° 2023-380 du 19 mai 2023 relative aux Jeux olympiques et paralympiques de 2024 (loi « JOP2024 ») autorise le recours à titre expérimental aux dispositifs de caméras augmentées pour assurer la sécurité de certains grands évènements sportifs, récréatifs et culturels jusqu’au 31 mars 2025. Le décret n° 2023-828 du 28 août 2023 précise les modalités de mise en œuvre des traitements autorisés par cette loi.

Cette loi autorise ainsi l’usage de caméras augmentées dans certaines conditions précises :

- Seuls les services visés par la loi sont autorisés – sous conditions – à utiliser des caméras « augmentées » pour détecter :

- la présence d’objets abandonnés ;

- la présence ou utilisation d’armes ;

- le non-respect du sens de circulation par une personne ou un véhicule ;

- le franchissement d’une limite ou la présence d’une personne ou d’un véhicule dans une zone interdite ou sensible ;

- la présence d’une personne au sol à la suite d’une chute ;

- un mouvement de foule ;

- une densité trop importante de personnes ;

- un départ de feu.

- Tous les autres cas d’usage qui ne sont pas expressément prévus par le décret ne peuvent pas être mis en œuvre pour assurer la sécurité des manifestations sportives, récréatives ou culturelles.

Par exemple : la détection d’une bagarre ou d’une agression physique dans le cadre d’une manifestation sportive.

Les garanties prévues par la loi JOP2024

Les garanties prévues par la loi vont dans le sens des préconisations formulées par la CNIL dans sa prise de position sur les caméras augmentées de juillet 2022 et de son avis rendu sur le projet de loi JOP 2024 :

- Le déploiement des caméras augmentées est expérimental, limité dans le temps et l’espace et mis en œuvre pour certaines finalités spécifiques et correspondant à des risques pour la sécurité des personnes.

- Les dispositifs ne peuvent pas impliquer le traitement de données biométriques, et notamment la .

- Les traitements doivent permettre de détecter et de signaler, en temps réel, des événements prédéterminés à des agents qui procéderont ensuite à une analyse humaine. Ces détections automatisées ne pourront fonder, en elles-mêmes, aucune décision individuelle ni poursuite.

- Le rapprochement avec d’autres fichiers est exclu.

Hors du cadre expérimental de la loi JOP2024

Le déploiement de caméras augmentées ne pourra être envisagé que dans les conditions exposées dans la position de la CNIL de juillet 2022 et rappelées ici.

Un des personnes concernées difficile à respecter

Les personnes filmées et analysées par les dispositifs de caméras « augmentées » disposent de droits reconnus par la réglementation sur la protection des données, parmi lesquels figure souvent le droit de s’opposer au traitement mis en œuvre.

Or, les personnes ne peuvent généralement pas s’opposer à l’analyse de leur image. En effet, les conditions d’exercice du droit d’opposition sont, la plupart du temps, difficilement acceptables en pratique (exprimer son opposition par un mouvement corporel significatif, se placer dans un espace dédié, scanner un QR code, etc.). De telles modalités sont peu praticables dans les faits et difficilement réalistes dans la vie quotidienne. Par ailleurs, l’existence même d’un droit d’opposition pourrait, dans certains cas, être incompatible avec l’objectif même du traitement.

Par conséquent, ces dispositifs ne peuvent généralement être mis en œuvre que dans les cas où ce droit peut être écarté.

La réglementation prévoit qu’une telle limitation des droits n’est possible que dans deux cas de figure :

- Le droit d’opposition est écarté par un texte spécifique qui s’appuie sur l’article 23 du RGPD :ce texte devra acter la légitimité et la proportionnalité du traitement au regard de l’objectif poursuivi, la nécessité d’exclure la faculté pour les personnes de s’y opposer, tout en fixant des garanties appropriées au bénéfice de ces dernières.

Il est désormais admis qu’une collectivité publique qui dispose d’un pouvoir réglementaire pour l’exercice de ses missions puisse adopter un texte au sens de cet article (pour plus d’informations, voir « Droit d’opposition : les conditions de dérogation en vertu de l’article 23 du RGPD »).

- Le traitement impliqué par le dispositif de vidéo « augmentée » poursuit uniquement une finalité statistique au sens du RGPD, c’est-à-dire que le traitement ne tend qu’à la production de résultats statistiques constitués de données agrégées et anonymes. Il n’a pas de vocation directement opérationnelle (déclencher une alerte, afficher une publicité, bloquer l’accès à un quai de gare, etc.).

Par exemple : un dispositif affichant de manière anonyme le taux d’affluence dans un métro pour indiquer aux voyageurs les rames les moins remplies vers lesquelles se diriger, serait en principe possible, sous réserve de respecter le RGPD.

D’un point de vue juridique, dans de nombreux cas, l’usage des caméras augmentées dans l’espace public ne pourra ainsi être autorisé que par des textes législatifs ou réglementaires.

D’un point de vue politique, il est nécessaire que la puissance publique trace la ligne entre ce qu’il est souhaitable de faire d’un point de vue éthique et social et ce qui ne l’est pas, au-delà du « techniquement faisable » dans notre société démocratique.

Dans tous les cas, respecter les grands principes de la réglementation sur les données personnelles

Tout acteur qui souhaiterait déployer un dispositif de vidéo « augmentée » devra respecter la réglementation relative à la protection des données personnelles. Cela implique notamment :

- de déterminer une au cas par cas ;

- de démontrer, au préalable, la proportionnalité du dispositif envisagé.

À ce titre, des mécanismes effectifs de protection des données et de la vie privée dès la conception (privacy by design) doivent être mis en œuvre pour permettre de réduire les risques pour les personnes concernées. Des garanties fortes consistent, par exemple, à intégrer des mesures permettant la suppression quasi-immédiate des images sources ou la production d’informations anonymes.

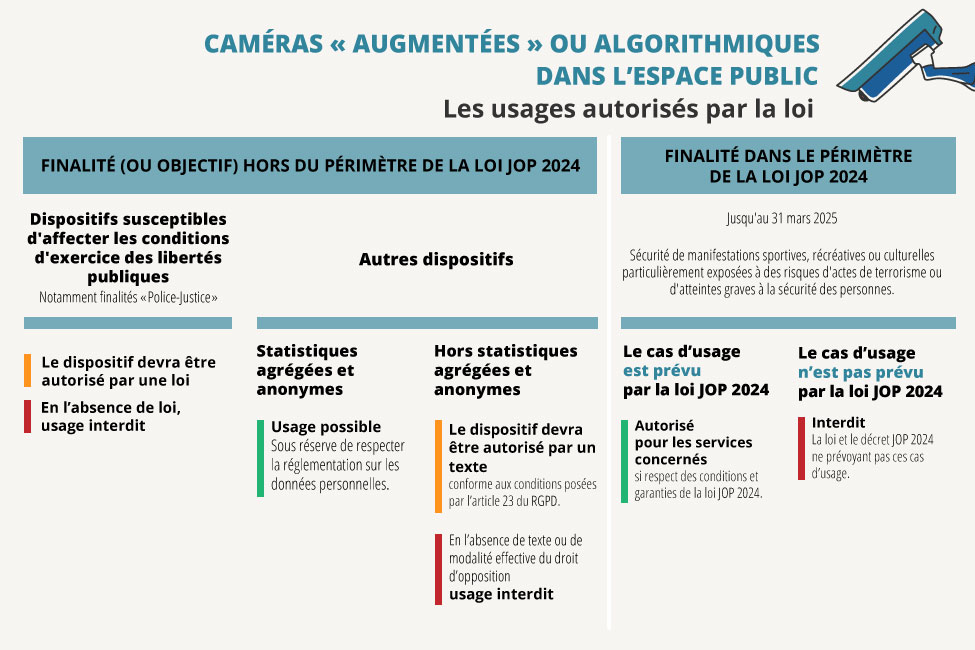

[Infographie] Quels cas d’usages sont possibles ?

Titre : Caméras « augmentées » ou algorithmiques dans l'espace public

Les usages autorisés par la loi

- Finalité (ou objectif) hors du périmètre de la loi JOP 2024

- Dispositifs susceptibles d'affecter les conditions d'exercice des libertés publiques (notamment finalités "Police-Justice") :

- Le dispositif devra être autorisé par une loi.

- En l'absence de loi, usage interdit.

- Autres dispositifs :

- Statistiques agrégées et anonymes : Usage possible sous réserve de respecter la réglementation sur les données personnelles.

- Hors statistiques agrégées et anonymes : Le dispositif devra être autorisé par un texte conforme aux conditions posées par l'article 23 du RGPD. En l'absence de texte ou de modalité effective du droit d'opposition, usage interdit.

- Finalité dans le périmètre de la loi JOP 2024

Jusqu'au 31 mars 2025. Sécurité de manifestations sportives, récréatives ou culturelles particulièrement exposées à des risques d'acte de terrorisme ou d'atteintes graves à la sécurité des personnes.

- Le cas d'usage est prévu par la loi JOP 2024 :

- Autorisé pour les services concernés si respect des conditions et garanties de la loi JOP 2024.

- Le cas d'usage n'est pas prévu par la loi JOP 2024 :

- Interdit. La loi et le décret JOP 2024 ne prévoient pas le cas d'usage.

Récapitulatif des règles à respecter

Pour approfondir

- Jeux olympiques et paralympiques 2024 : la CNIL publie son avis sur le projet de loi

- Délibération n° 2023-068 du 15 juin 2023 portant avis sur un projet de décret relatif aux modalités de mise en œuvre des traitements algorithmiques dans le cadre de l’expérimentation prévue par la loi JOP2024

- Délibération n° 2023-060 du 29 juin 2023 portant avis sur un projet de décret relatif aux modalités de pilotage et d'évaluation de l'expérimentation de traitements algorithmiques mis en œuvre par la loi JOP2024

- JOP 2024 : les questions-réponses de la CNIL sur votre vie privée et vos libertés